大数据时代下计算机软件技术的开发、维护与应用探究

随着信息技术的飞速发展,人类社会已全面迈入大数据时代。海量、多样、高速、低价值密度的数据不仅重塑了社会经济形态,也对计算机软件技术的开发与维护提出了前所未有的挑战与机遇。本文旨在探讨大数据背景下,软件开发与维护的核心技术演进及其在各领域的创新应用。

一、 大数据时代对软件技术开发的新要求

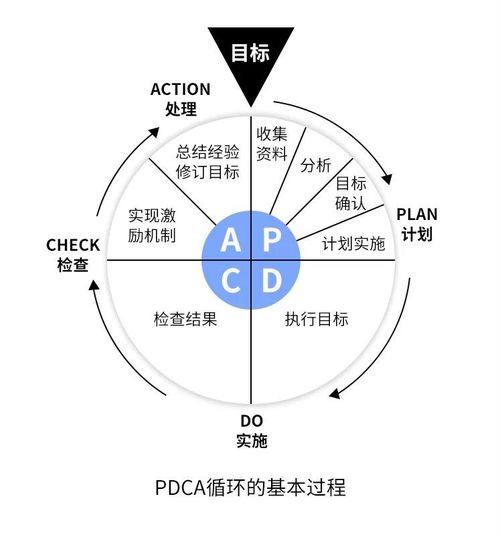

传统的软件开发模式,如瀑布模型,难以适应大数据环境下需求的快速变化和海量数据的实时处理要求。因此,敏捷开发(Agile)、DevOps(开发运维一体化)和持续集成/持续部署(CI/CD)等新型开发范式成为主流。这些模式强调迭代、协作和自动化,能够快速响应业务需求,实现软件的快速交付与迭代更新。在技术架构层面,面向大数据的软件系统通常采用微服务架构,将复杂的单体应用拆分为一组小型、独立的服务,每个服务围绕特定业务功能构建,并通过轻量级机制(如RESTful API)进行通信。这种架构提高了系统的可扩展性、灵活性和容错能力,便于应对数据量的激增和处理任务的复杂化。

二、 核心技术:数据处理与智能分析

大数据时代软件技术的核心在于对数据的获取、存储、处理与分析。这催生了一系列关键技术栈的广泛应用:

- 分布式存储与计算框架:以Hadoop HDFS、Apache Spark、Flink为代表的分布式系统,解决了单机无法存储和处理海量数据的问题。它们将数据和计算任务分布到集群中的多个节点上并行处理,极大提升了效率。

- NoSQL与NewSQL数据库:为应对结构化、半结构化和非结构化数据的多样化存储需求,Redis、MongoDB、Cassandra等NoSQL数据库,以及具备横向扩展能力的NewSQL数据库(如Google Spanner、TiDB)应运而生,弥补了传统关系型数据库在可扩展性和灵活性上的不足。

- 大数据处理与流计算:对于实时数据流(如物联网传感器数据、在线交易日志),Storm、Spark Streaming、Flink等流计算框架能够实现低延迟的实时处理与分析,支持即时决策。

- 人工智能与机器学习集成:软件智能化是大数据应用的必然趋势。通过集成TensorFlow、PyTorch等机器学习框架,软件能够从数据中自动学习模式、做出预测或进行分类,实现智能推荐、风险预警、图像识别等高级功能。

三、 软件维护技术的演进:智能运维(AIOps)

在大数据环境下,软件系统的规模与复杂性剧增,传统人工运维模式难以为继。智能运维(AIOps)应运而生,它利用大数据和人工智能技术来增强和自动化IT运维流程。AIOps平台能够:

- 海量运维数据聚合:从日志、监控指标、事件等多元数据源中收集数据。

- 异常检测与根因分析:通过机器学习算法自动识别系统性能异常、故障征兆,并快速定位问题根源,大幅缩短平均修复时间(MTTR)。

- 自动化修复与预测性维护:在检测到问题后,可自动执行预设的修复脚本,甚至基于历史数据进行趋势分析,预测潜在故障,实现从“被动响应”到“主动预防”的转变。

四、 应用实践与未来展望

大数据驱动下的软件技术已深度渗透各行各业:

- 金融科技:用于实时反欺诈、信用风险评估和量化交易。

- 智慧城市:整合交通、安防、环境数据,优化公共资源配置和城市管理。

- 精准医疗:分析基因组学、临床记录等数据,辅助疾病诊断和个性化治疗方案制定。

- 智能制造:通过工业物联网数据优化生产流程,实现预测性设备维护。

- 互联网服务:支撑搜索引擎、个性化内容推荐和社交媒体分析。

随着边缘计算的兴起,数据处理将更靠近数据源,对软件的实时性和低延迟提出更高要求。数据安全与隐私保护(如联邦学习、同态加密等隐私计算技术)将更深地融入软件开发生命周期。云原生技术(容器化、服务网格、声明式API)将进一步简化大数据应用的开发、部署与管理。

结论:大数据时代重塑了计算机软件技术的开发范式、技术栈与维护理念。软件不再仅仅是实现功能的工具,更是挖掘数据价值、驱动业务创新与智能决策的核心引擎。开发者与维护者必须持续学习,掌握分布式、智能化、自动化的关键技术,并高度重视数据伦理与安全,才能构建出稳定、高效、智能且可信的软件系统,充分释放大数据的巨大潜能。

如若转载,请注明出处:http://www.syz999.com/product/66.html

更新时间:2026-04-17 00:30:03